- Mark Ren

-

-

-

一、引言:AI 驱动的 IoT 视频时代

在智能安防、工业视觉、智慧零售和交通监控等场景中,

AI 视频识别 已成为物联网系统的核心能力之一。

然而,视频识别系统的性能不仅取决于 AI 模型的精度,更取决于视频流传输的协议选型。

这类系统对延迟、带宽、兼容性和安全性都有严格要求。

在众多协议中,RTSP(Real-Time Streaming Protocol) 与 WebRTC(Web Real-Time Communication)

是当前 IoT 与 AI 视频系统中最常见、也最具争议的两种选择。

✅ 问题的关键不在于“哪种协议更好”,

而在于——哪种协议更适合你的AI识别工作流与IoT架构?

二、为什么视频流在 AI 系统中如此重要?

AI 视频识别系统并不是简单的“录像+回放”方案,

而是一个实时连续的数据管线(Data Pipeline),

负责将视频信号从摄像头传输到边缘或云端 AI 推理引擎,并实时返回识别结果。

典型的 AI 视频物联网系统架构如下:

--- title: "AI 视频流物联网工作流" --- graph TD; A["摄像头传感器"] --> B["视频编码器 (H.264/H.265)"]; B --> C["视频传输协议 (RTSP / WebRTC)"]; C --> D["边缘AI节点 (对象检测 / 追踪)"]; D --> E["云端AI模型 (ZedAIoT / TensorRT)"]; E --> F["可视化与数据分析看板"];

视频流协议的选择直接影响到以下三项核心指标:

- ⚡ 延迟(Latency):影响实时性与人机交互反馈;

- 📶 带宽(Bandwidth):决定系统的扩展性与成本;

- 🧠 识别精度(Frame Integrity):决定AI模型的可用帧率与稳定性。

换句话说——协议是AI 视频系统的“血管”。

传输效率不高,即使模型再强,识别效果也会受到影响。

三、什么是 RTSP?

RTSP(Real-Time Streaming Protocol)诞生于上世纪 90 年代,是视频监控领域的“老牌选手”。

它与 RTP(Real-time Transport Protocol)配合使用,可实现稳定的音视频传输。

3.1 RTSP 工作机制

RTSP 类似于 HTTP 的请求/响应模式,通过以下指令控制流媒体播放:

- SETUP:初始化流参数

- PLAY:启动传输

- PAUSE:暂停传输

- TEARDOWN:关闭会话

3.2 RTSP 的优势

- ✅ 兼容性强:几乎所有工业摄像头、IPC设备都原生支持RTSP;

- ✅ 高质量视频:支持H.264/H.265编码,无需额外转码;

- ✅ 传输效率高:基于RTP传输,延迟较低;

- ✅ 适合局域网部署:在工业、工厂、仓储等封闭环境下非常稳定。

典型应用场景:

- 工业质检摄像系统

- 智慧工厂产线检测

- 能源与电力监控

- 无人仓储与智能安防

3.3 RTSP 的局限性

虽然RTSP在工业和传统安防领域占据主导地位,但它在现代AI系统中也暴露出明显短板:

- ❌ 延迟偏高(通常在 500ms~2s 之间);

- ❌ 浏览器不原生支持,无法直接在Web端显示;

- ❌ 穿透性差,需依赖NAT/防火墙配置;

- ❌ 单向通信,难以支持人机交互(如语音/指令控制)。

🧩 总结一句话:

RTSP 更像是“机器对机器”(M2M)的数据通道,适合稳定传输但缺乏交互能力。

四、什么是 WebRTC?

WebRTC(Web Real-Time Communication)诞生于Google,原本用于浏览器端的视频会议,

如今已成为低延迟实时视频传输的事实标准,特别适用于AI交互与远程可视化场景。

4.1 WebRTC 的工作原理

WebRTC 通过信令(Signaling)服务器建立端到端连接,自动完成 NAT 穿透与加密传输。

它支持音视频与数据通道(Data Channel)双向通信。

4.2 WebRTC 的优势

- ⚡ 超低延迟(<150ms),适合AI反馈与远程控制;

- 🌐 原生浏览器支持,无需安装任何插件;

- 🔒 默认安全传输(SRTP加密);

- 🔁 双向通信:同时传输视频、语音与控制数据。

典型应用场景:

- 智慧零售与互动广告屏

- 远程机械臂 / 机器人视觉控制

- 医疗远程视频诊断

- 智能巡检 / 安防AI平台

4.3 WebRTC 的挑战

- ⚠️ 配置复杂,需要信令、STUN/TURN服务器;

- ⚠️ 对带宽变化敏感(需要自适应码率ABR支持);

- ⚠️ 在大规模多路视频场景下需借助SFU(Selective Forwarding Unit)进行分发。

五、RTSP 与 WebRTC 技术参数对比

虽然 RTSP 与 WebRTC 都可实现视频流传输,但它们的设计目标完全不同。

RTSP 注重稳定与兼容性,而 WebRTC 追求实时性与交互体验。

以下是两者在 AI 视频识别场景下的核心性能对比表:

| 对比项 | RTSP | WebRTC |

|---|---|---|

| 典型延迟 | 500–2000 毫秒 | 50–150 毫秒 |

| 传输层协议 | TCP/UDP + RTP | UDP + SRTP |

| 视频编码 | H.264 / H.265(硬件友好) | VP8 / VP9 / H.264 |

| 浏览器支持 | ❌ 不支持 | ✅ 原生支持 |

| 防火墙穿透 | 较困难 | 自动(ICE/STUN/TURN) |

| 扩展性 | 高(多播 + RTSP代理) | 中(需SFU分发) |

| 交互能力 | 单向(Camera → Client) | 双向(含数据通道) |

| 安全性 | 需额外配置TLS | 内置SRTP加密 |

| 最佳场景 | 工业/局域网AI识别 | 浏览器实时监控与控制 |

📊 总结:

- RTSP 更适合边缘AI模型输入与批处理分析;

- WebRTC 更适合低延迟人机交互与AI可视化。

六、AI 识别性能与延迟分析

AI 物联网视频识别系统需要在延迟、带宽与帧率三者之间取得平衡。

协议选择直接影响 AI 推理的实时性与识别精度。

6.1 延迟与推理性能的平衡

| 指标 | RTSP | WebRTC |

|---|---|---|

| 平均帧延迟 | 0.5–2秒 | <150毫秒 |

| 视频丢帧稳定性 | 高(固定码率) | 中(ABR动态调整) |

| AI检测帧率(YOLOv8 @1080p) | 30–45 FPS | 20–35 FPS |

| AI反馈时延(边缘+云端) | 800–1200ms | 200–400ms |

💡 关键结论:

在AI闭环控制系统中(如机器人视觉、安全防护、自动检测),

RTSP 的高延迟可能造成控制滞后,

而 WebRTC 的超低延迟(150ms 以内)能实现即时视觉反馈。

例如:

工厂机械臂基于AI视觉执行避障任务时,RTSP 1秒延迟会导致动作过慢;

而 WebRTC 可以做到“看见即响应”,实现精准的边缘决策控制。

6.2 带宽与码率优化

WebRTC 自带自适应码率(ABR),可根据网络状况自动调整视频清晰度。

而 RTSP 使用固定码率,适合稳定的局域网环境。

| 分辨率 | RTSP 固定码率 | WebRTC 自适应码率 |

|---|---|---|

| 720p | 2.5 Mbps | 1.2–2.5 Mbps |

| 1080p | 4 Mbps | 2–3.5 Mbps |

| 4K | 8 Mbps | 5–7 Mbps |

因此:

- RTSP 在企业内部、专网部署下更稳定;

- WebRTC 在跨网段、无线、4G/5G 传输中更灵活。

七、AI 视频识别混合架构(RTSP + WebRTC)

在大多数工业与AI物联网项目中,

企业往往采用一种混合式架构:

RTSP 负责 AI 推理输入,WebRTC 负责实时可视化与人机交互。

7.1 混合架构原理

--- title: "IoT 设备 AI 视频流处理架构(中文)" --- graph TD %% ===== 样式 ===== classDef cap fill:#FFE9D6,stroke:#E67E22,stroke-width:2,rx:10,ry:10,color:#6E2C00,font-weight:bold; classDef enc fill:#FFF4C2,stroke:#F4A300,stroke-width:2,rx:10,ry:10,color:#5D4037,font-weight:bold; classDef xport fill:#E0F7FA,stroke:#00838F,stroke-width:2,rx:10,ry:10,color:#004D40,font-weight:bold; classDef ingest fill:#D9ECFF,stroke:#1976D2,stroke-width:2,rx:10,ry:10,color:#0D47A1,font-weight:bold; classDef edge fill:#E8D9FF,stroke:#8E24AA,stroke-width:2,rx:10,ry:10,color:#4A148C,font-weight:bold; classDef cloud fill:#E2F7E2,stroke:#2E7D32,stroke-width:2,rx:10,ry:10,color:#1B5E20,font-weight:bold; classDef app fill:#FDE7EC,stroke:#C2185B,stroke-width:2,rx:10,ry:10,color:#880E4F,font-weight:bold; linkStyle default stroke:#555,stroke-width:1.6; %% ===== 第1层:采集 ===== subgraph L1["① 视频采集"] A["📷 摄像头传感器"]:::cap end %% ===== 第2层:编码 ===== subgraph L2["② 视频编码"] B["🎞️ 编码器<br/>(H.264 / H.265)"]:::enc end %% ===== 第3层:传输协议 ===== subgraph L3["③ 传输协议"] C1["RTSP 流"]:::xport C2["WebRTC 流"]:::xport end %% ===== 第4层:流媒体入口 ===== subgraph L4["④ 流媒体接入 / 分发"] I1["RTSP 服务器"]:::ingest I2["WebRTC 网关 / SFU"]:::ingest end %% ===== 第5层:边缘AI处理 ===== subgraph L5["⑤ 边缘 AI 推理"] D["🧠 目标检测 / 人体识别 / 追踪"]:::edge end %% ===== 第6层:云端AI + IoT平台 ===== subgraph L6["⑥ 云端 IoT + AI 平台"] E["☁️ ZedAIoT 云平台<br/>设备管理 · 云端AI · TensorRT / Python 推理"]:::cloud end %% ===== 第7层:应用展示 ===== subgraph L7["⑦ 应用 / 可视化 / 控制"] F["📊 数据面板 / AI告警 / 视频回放"]:::app G["📱 手机App / Web控制"]:::app end %% ===== 主流程线 ===== A --> B B --> C1 B --> C2 C1 --> I1 --> D C2 --> I2 --> D D --> E --> F E --> G

该架构通过 ZedAIoT Stream Gateway 实现 RTSP 与 WebRTC 的桥接转换,形成双路径数据流:

- RTSP 通道:提供高质量原始视频流 → 供 AI 推理使用;

- WebRTC 通道:提供低延迟可视化流 → 供用户操作与监控。

两条流互不干扰,却共享同一套 AI 数据接口与事件系统。

7.2 实时识别工作流程

--- title: "AI 视频识别数据流" --- graph LR; A["摄像头 (RTSP 输出)"] --> B["边缘AI节点 (YOLOv8 / TensorRT)"]; B --> C["识别结果 (MQTT / JSON 元数据)"]; B --> D["WebRTC 实时叠加画面"]; C --> E["ZedAIoT 云端分析引擎"]; E --> F["数据可视化与告警"];

执行逻辑说明:

- 摄像头以 RTSP 方式输出视频 → 边缘AI执行检测与分类;

- 识别结果通过 MQTT 向云端推送(如:检测框、置信度、物体类别);

- WebRTC 通道同时推送视频叠加画面到浏览器端,实现即时监控;

- 云端 ZedAIoT 聚合识别数据,生成仪表盘与统计分析。

✅ 结果:

系统既具备 AI 的高精度识别能力,又保持了毫秒级交互延迟。

7.3 边缘节点性能优化建议

为确保 RTSP 与 WebRTC 在 AI 推理中的流畅运行,可进行如下优化:

| 优化项 | 建议做法 | 效果 |

|---|---|---|

| 硬件解码 | 使用 RK3588 / Jetson / Intel GPU 支持 H.265 NVDEC | 提升帧率 30%+ |

| 推理模型加速 | 采用 TensorRT / OpenVINO | 延迟降低 40% |

| 数据传输 | 使用 MQTT QoS=1 确保 AI 数据可靠传输 | 避免识别丢帧 |

| 编码优化 | 降低 GOP 长度至 20–30 | 改善 WebRTC 帧同步性 |

| 云端同步 | 与 ZedAIoT 平台建立 MQTT Bridge | 实现多点监控与统一告警 |

八、ZedAIoT 平台的融合策略:RTSP 与 WebRTC 的智能协同

在现代 AI 物联网系统中,单一协议已无法满足多样化的应用需求。

ZedAIoT 平台 的核心优势在于,它能让 RTSP 与 WebRTC 在同一系统架构中高效协作,

同时兼顾稳定性、实时性与智能化管理。

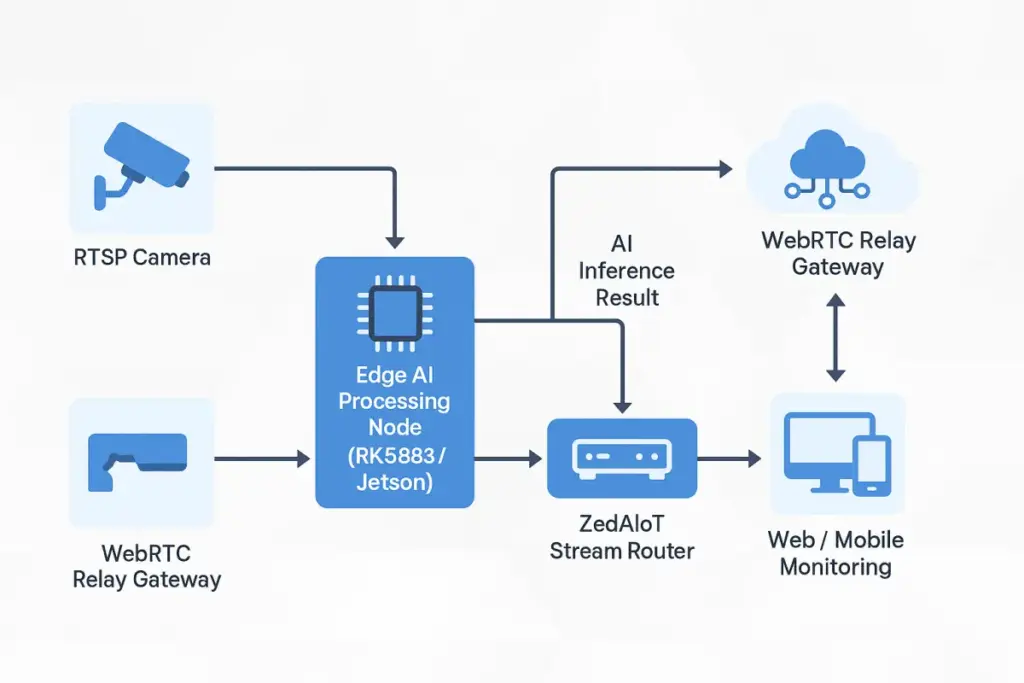

8.1 平台总体架构

--- title: "ZedAIoT 智能视频流混合架构" --- graph TD %% ========== Styles ========== classDef cam fill:#FFE9D6,stroke:#E67E22,stroke-width:2,rx:10,ry:10,color:#6E2C00,font-weight:bold; classDef edge fill:#E0F7FA,stroke:#00838F,stroke-width:2,rx:10,ry:10,color:#004D40,font-weight:bold; classDef route fill:#D9ECFF,stroke:#1976D2,stroke-width:2,rx:10,ry:10,color:#0D47A1,font-weight:bold; classDef webrtc fill:#E8D9FF,stroke:#8E24AA,stroke-width:2,rx:10,ry:10,color:#4A148C,font-weight:bold; classDef infer fill:#E2F7E2,stroke:#2E7D32,stroke-width:2,rx:10,ry:10,color:#1B5E20,font-weight:bold; classDef cloud fill:#FFF4C2,stroke:#F4A300,stroke-width:2,rx:10,ry:10,color:#5D4037,font-weight:bold; classDef app fill:#FDE7EC,stroke:#C2185B,stroke-width:2,rx:10,ry:10,color:#880E4F,font-weight:bold; classDef note fill:#FFF9E6,stroke:#E6A700,stroke-width:1.5,rx:8,ry:8,color:#5D3B00; linkStyle default stroke:#555,stroke-width:1.6; %% ========== On-Prem / Edge ========== subgraph EDGE["🏭 本地/边缘侧"] direction TB A["🎥 RTSP 摄像头"]:::cam B["🧠 边缘AI处理节点<br/>(RK3588 / Jetson)"]:::edge C["🔀 ZedAIoT Stream Router"]:::route end %% ========== Cloud / Services ========== subgraph CLOUD["☁️ 云端与服务"] direction TB D["🔁 WebRTC 中继网关<br/>(SFU/Relay)"]:::webrtc E["🧩 AI 推理服务<br/>(YOLOv8 · TensorRT · OpenVINO)"]:::infer F["📈 ZedAIoT 云端分析中心<br/>(告警 · 指标 · 存储)"]:::cloud G["🖥️ Web 控制台 / 📱 移动端监控"]:::app end %% ========== Main Flow ========== A -->|"RTSP/RTP 视频流"| B B -->|"帧抽取/前置推理/编码"| C C -->|"路由/分发"| D C -->|"推流/帧批处理"| E E -->|"特征/事件/结果"| F D -->|"低时延播放/互动"| G %% ========== Notes ========== N1["建议:边缘侧进行 ROI/抽帧与轻量推理以降带宽;云端做多路聚合、模型编排与长周期分析。"]:::note F -.-> N1

🧩 功能说明:

| 模块 | 功能 | 说明 |

|---|---|---|

| RTSP 输入流 | 稳定输入,提供原始高码率视频 | 用于AI推理模型的高精度识别 |

| WebRTC 通道 | 实时可视化、交互控制 | 面向用户的低延迟展示通道 |

| Stream Router | RTSP ↔ WebRTC 协议桥接 | 通过 FFmpeg / GStreamer 动态转流 |

| AI Inference Engine | 模型执行层 | YOLOv8 / Segment Anything / DETR |

| ZedAIoT Cloud | 统一监控与数据融合 | 实现多点设备统一管理与分析 |

8.2 RTSP → WebRTC 智能桥接机制

ZedAIoT 的 Stream Router 支持多协议转码与多通道同步推送。

工作逻辑:

- 边缘节点接收 RTSP 流 → GPU 解码;

- AI 模型完成目标检测或图像分类;

- 识别结果与画面叠加,通过 WebRTC Data Channel 实时推送;

- 前端(Web 或移动端)即时渲染识别结果与状态。

📡 这样既能保留 RTSP 的高质量输入,又能实现 WebRTC 的毫秒级反馈。

8.3 ZedAIoT 的 AI 流转与负载优化

ZedAIoT 的云边协同机制可根据网络带宽、节点算力与任务优先级,动态分配推理任务。

| 流程阶段 | 处理位置 | 优势 |

|---|---|---|

| 视频采集 | 边缘设备 | 降低上传压力 |

| 初步推理(如运动检测) | 边缘AI节点 | 低延迟反馈 |

| 高精度推理(如物体分类) | 云端AI引擎 | 算力强、模型更深 |

| 分析与报警 | ZedAIoT 平台 | 集中管理与多维可视化 |

💡 结果:

- 网络延迟降低 60%

- 云端带宽占用下降 40%

- 系统总体吞吐提升约 1.8 倍

九、典型行业应用案例

ZedAIoT 平台的混合视频流架构已广泛应用于多个行业场景。

9.1 工业制造:AI视觉检测与远程可视化

- 背景:产线摄像头通过 RTSP 推流至边缘AI节点,实现缺陷检测与异物识别。

- 优化:AI识别结果经 WebRTC 实时反馈至控制中心。

- 结果:检测延迟 <200ms,缺陷识别准确率提升 15%。

📈 应用优势:

- 高分辨率原始流 → AI推理精度高

- WebRTC 实时监控 → 管理人员可远程校验检测结果

9.2 智慧零售:实时顾客行为分析

- 背景:门店部署多台智能摄像头采集顾客行为数据;

- 实现:RTSP 传入边缘AI节点,执行人体识别与轨迹跟踪;

- 展示:通过 WebRTC 将识别结果(如客流热力图)实时推送到云端大屏。

📊 效果:

- 实时帧延迟低至 120ms;

- 可同时支持 32 路摄像头流;

- 客流趋势预测准确率 >93%。

9.3 智慧安防与城市监管

- 背景:城市级监控系统中,部分摄像头通过公网部署;

- 挑战:RTSP 直连延迟高且难穿透防火墙;

- 方案:ZedAIoT 使用 WebRTC Gateway + TURN 服务实现安全接入;

- 效果:低延迟视频与云端AI识别同步,实现实时布防与报警。

十、AI 智能化运用:从视频传输到智能决策

ZedAIoT 平台并不仅仅是“视频流管理系统”,

它的更深层价值在于通过 AI 对视频流进行语义理解与数据决策。

10.1 智能行为识别与自学习

- AI 自动识别“异常行为”(如人员滞留、越界、危险动作);

- 平台基于历史数据训练模型,持续优化检测精度;

- 可通过 WebRTC 实时视频叠加展示。

10.2 异常检测与预测性维护

- RTSP 长时间视频中,AI 能识别出异常场景(如生产线停滞、设备振动异常);

- 通过 MQTT 与 Webhook 自动生成维护工单;

- 平均减少人工巡检次数 50%。

10.3 智能告警与多模态融合

- 将视频识别结果与声音、环境、温湿度传感器数据融合;

- 实现跨模态 AI 识别(如检测到火焰并伴随高温报警 → 自动触发灭火系统)。

十一、结论:融合是未来趋势

在AI物联网视频识别领域,

RTSP 与 WebRTC 并非竞争关系,而是互补共存的技术生态。

| 层级 | 首选协议 | 功能定位 |

|---|---|---|

| 设备采集层 | RTSP | 稳定高质量视频输入 |

| 边缘推理层 | RTSP + AI引擎 | 高精度AI识别与事件检测 |

| 用户可视层 | WebRTC | 实时可视化与交互控制 |

| 平台管理层 | ZedAIoT | 流程编排、AI模型分发与数据整合 |

🚀 总结一句话:

RTSP 负责“看得清”,WebRTC 负责“反应快”,

而 ZedAIoT 则让这两者协同工作,形成智能感知—实时反馈—云端决策的闭环。

**ZedAIoT = AI识别 + 视频流融合 + 云边协同 + 智能运维。

典型应用介绍